A plataforma de games Roblox e o aplicativo de comunicação Discord implementaram novas medidas de segurança para crianças e adolescentes.

+ Sony aposta em app de controle parental para PlayStation

+ Ferramentas de controle de jogos e apps podem ser aliadas dos pais

Isso porque o ambiente digital oferecido por esses aplicativos estão sendo utilizados para crimes graves, como aliciamento, chantagem e abuso de menores.

O que mudou?

- Desde dia 7 de janeiro, o Roblox implementou um sistema de verificação de idade através de reconhecimento facial

- Usuários que não realizam a identificação passaram a ser proibidos de se comunicar pelo chat

- A partir de março, o Discord vai aplicar o mesmo método de identificação em seu app

- Menores de idade terão restrições na hora de entrar em canais privados, além de configurações diferenciadas de privacidade

Criando um monstro

Ambientes digitais vão além das redes sociais. O Roblox começou com uma ideia simples: permitir que crianças e adolescentes expressassem sua criatividade online. Ali, usuários podiam interagir em grupos, decorar seus avatares e participar dos milhares de jogos.

Como tudo na internet, uma ótima proposta inicial pode se tornar um monstro incontrolável.

No caso do Roblox, os primeiros sinais vieram na fatura dos cartões dos pais: uma epidemia de crianças gastando o dinheiro da compra do mês em itens do jogo, sem nenhum sistema que reconhecesse que aquela transação não estava sendo feita por um maior de idade.

Relatos de bullying e assédio contra menores não demoraram a aparecer e até viraram noticiário policial. O monstro cresceu.

E cresceu também no Discord, que começou como um simples aplicativo de comunicação, uma modernização de softwares com interface ultrapassada.

Ao contrário dos seus antecessores, ele era mais cool, rápido, comunitário, e permitia chat de vídeo, o que fez o número de usuários saltar a partir da pandemia.

Em um ambiente onde muitos se encontravam para jogar em grupo, dar risada e aliviar os efeitos do isolamento social, outros se identificavam por motivos menos nobres.

Formavam grupos que passaram a exercer poder, nada diferente do que aconteceria em uma escola sem monitoramento e hierarquia.

Figuras de poder dentro de grupos virtuais também são capazes de exercer controle físico, especialmente sobre crianças e adolescentes. E surgiram casos de grupos de tortura e de compartilhamento de conteúdo sensível. Assim, a ideia original do Discord foi desfigurada.

As medidas citadas no início na matéria vieram para conter o incêndio.

No Roblox, um sistema de reconhecimento facial com uso de IA já está no ar, ajudando a determinar a idade dos usuários antes de dividi-los em ambientes com interações limitadas aquela faixa etária.

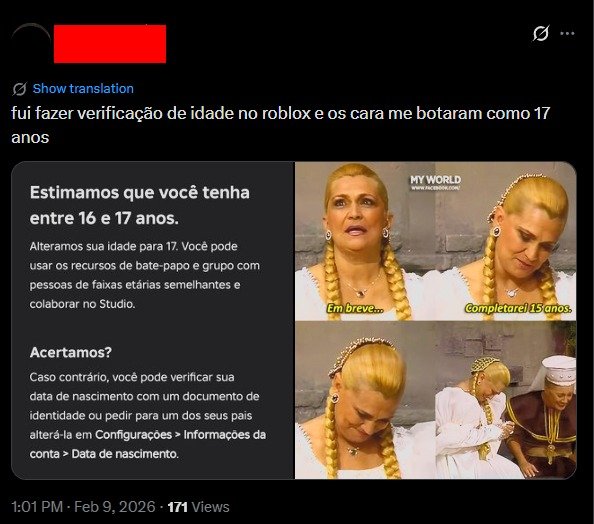

Mas não demorou para usuários utilizarem as redes sociais para reportar falhas no sistema implementado, com adolescentes de 15 anos sendo classificados como adultos, e vice-versa.

Usuários usaram as redes sociais para relatar falhas em identificação de idade do Roblox (Foto: Reprodução)

A reportagem questionou a empresa sobre possíveis aprimoramentos na tecnologia

“Como nenhum sistema é perfeito, implementamos maneiras para os usuários que cometeram um erro atualizarem sua idade (por exemplo, um pai que inadvertidamente concluiu o processo de verificação de idade para seu filho)”, afirmou a empresa, à IstoÉ.

A empresa ainda afirmou que possui ferramentas ‘especificamente desenvolvidas para detectar e sinalizar aparências manipuladas’.

)

)